求人サイトのSEOは、立ち上げ前の技術設計から運用KPI、JobPostingの実装や重複対策、クロール制御、原稿テンプレまでが一つの連動した仕組みとして成立したときに最大化します。

本ガイドは、立ち上げから安定運用までの実務で“今すぐ動かせる”手順を体系化し、当社NYマーケティングの現場知見と失敗回避のコツを織り込みながら、応募数を継続的に伸ばす戦術を具体化します。

初期構築で絶対必要な技術要件

ローンチ初期のクロールとインデックス獲得は、以後の成否を左右します。SSR(サーバーサイドレンダリング)で完全なHTMLを返し、構造化データと応答速度を最優先で設計・検証します。

初期構築は「Googleクローラーに最短で確実に見つけてもらう」ための土台作りです。特にSSR(サーバーサイドレンダリング)は、GooglebotだけでなくJavaScript実行が不得手なAI系ボットにも有利で、将来のLLMO/SGE対応でも優位に働きます。最新技術に飛びついてCSR(クライアントサイドレンダリング)中心にすると、レンダリング遅延や失敗でインデックス・評価が伸びず、AIにも取り上げられない事例が実務で起きています。

要件定義では、SSRの適用範囲(一覧・詳細・カテゴリなど流入が見込める全ページ)、構造化データとメタ出力の仕様化、TTFB(Time To First Byte)やLCP(Largest Contentful Paint)といった応答目標、検証手順を明文化し、マーケ/SEOと開発で「SEO最優先」の共通認識を設けることが不可欠です。公開直後はGoogleサーチコンソールと生ログでクロール・インデックスの初動をモニタし、逸脱があれば即時に戻す体制を準備します。

サーバーサイドでHTMLを出力する設計

SSRを採用する最大の理由は、クローラーとAIボットが最も確実に理解できるのが“サーバーが返す完成HTML”だからです。求人サイトは一覧・詳細・カテゴリの3系統が流入の柱となるため、これらSEOが期待される全ページでSSRを徹底するのが望ましい運用です。

小予算での現実解はWordPressや既製CMSの採用ですが、独自の入稿フローや複雑な承認、将来的な機能拡張が前提なら、PHP/Ruby/Java/Node(SSR対応)等でのフルスクラッチが長期コストで有利になる場面が多く、保守人材の確保しやすさも含めた総合評価が重要です。

実務の失敗例として、CSR中心のSPA(シングルページアプリケーション)で公開した結果、レンダリング待ちでインデックスが進まず、Google for JobsやAI面にも露出できなかったケースがあります。これを防ぐには、要件定義時に「SSR適用ページ一覧」「構造化データの生成責務」「応答時間SLO」「検証/受入テスト項目」を仕様書に落とし、自動検証(HTMLスナップショット比較や構造化データ検証API叩き)まで組み込むことが現実解です。

JavaScriptレンダリングがNGな理由と代替策

GoogleはJSレンダリングを行えますが、実行タイミングの遅延、リソース制約、失敗時のフォールバックなど“不確実性”が残ります。大量の求人を日々追加・更新・終了する求人サイトでは、この不確実性が即ち機会損失になり、ローンチ初期のインデックス遅延は採用成果に直結します。

加えて、LLM/SGEを含むAI系ボットはJSを実行しない/できない場合が多く、JS依存はAI面での不可視化リスクになります。代替策としては、サーバーで完成HTMLを返すシンプルなSSRこそが正攻法です。PHP、Ruby on Rails、Spring Boot、Next.jsのSSR/SSGなど、言語は問わず「URLに対して完全なHTMLを同期応答できるか」を判断基準にしてください。

妥協ラインはLLMO対応前提なら極力置かず、どうしても必要な場合でも“SEO非重要ページのみCSR”の最小限に留めるのが安全です。レンダリング要因の不確実性を設計段階で排除し、検証工程を自動化することが、短期の露出と長期の安定運用を両立します。

システム選定の実務指針と改修コスト方針

CMS/フレームワーク選定は、初期予算、運用性、拡張性、人材確保のしやすさの4軸でバランスを取るのが実務的です。

小規模スタートならWordPress等の既製CMSに、JobPostingの自動生成・テンプレ出力・サイトマップ分割を実装して短期で成果を出し、要件が肥大化した段階でフルスクラッチへ移行する“二段ロケット”も合理的です。

後から詰む典型は、JSレンダリング主体の構成や、人材確保が難しい最新過ぎる言語/フレームワークを選ぶことです。初期構築費に加え、運用コスト(サーバー費用+月次の改善開発工数)を明示し、SSG(Static Site Generation)/キャッシュ戦略、DB負荷を含むピーク時の応答SLOを定めましょう。

SEOで絶対に削れないのはSSRでのシンプルHTML出力とレスポンスの速さです。これが担保されないと、求人数や原稿品質を高めてもインデックスが進まず、評価も安定しません。改修コストは「テンプレ×自動生成×自動検証」を仕組化すると減少します。構造化データやメタ出力の仕様変更も“1箇所修正で全体反映”できる設計が、長期的な費用最小化に直結します。

JobPostingとGoogle for Jobs最適化

Google for Jobs掲載には正確なJobPosting実装と運用フローの標準化が必要です。必須プロパティ網羅、JSON-LD自動生成、GSC監視までを一貫運用してください。

JobPostingは“書けば載る”ではなく、“正しく、網羅的に、継続的に検証する”が基本です。必須プロパティ(title、description、jobLocation、employmentType、baseSalary等)の欠落は直ちに非表示につながり、構文エラーは索引から弾かれます。推奨プロパティは可能な範囲で最大限埋めつつ、推測や誇張は厳禁です。

運用は、入力フォームでのバリデーション→JSON-LDの自動生成→リッチリザルトテストでの事前検証→公開→GSCでの求人インデックス/表示データ監視→改善のPDCA、までを“仕組み化”します。表示されない場合は、技術エラー、項目漏れ、タイトル規約違反等を順に潰し、タイトルと説明のCTR改善も並行して回すと成果が加速します。

JobPostingの必須・推奨プロパティ一覧

JobPostingの中核は、雇用形態(employmentType)、給与(baseSalary)、勤務地(jobLocation)、タイトル(title)、説明(description)です。これらが欠ければGoogle for Jobsの露出は期待できません。

特に実務で見落とされがちなのが、titleとdescriptionを“検索者目線×CTR”で最適化することです。単に社内の職種名や定型文を転記するのではなく、地域名や雇用形態、給与レンジなど定量情報を織り込み、かつ過剰な訴求でポリシー違反を招かないバランスが求められます。

推奨プロパティ(hiringOrganizationの詳細、applicantLocationRequirements、validThrough、datePosted、incentiveCompensation等)は、実データがある範囲で積極的に埋めてください。無理な推測や誇張は、ユーザー体験の毀損とポリシー上のリスクになります。

運用ルールとして、入稿フォーム段階で必須項目のバリデーション、数値・通貨・日付の型チェック、公開前の自動検証を義務化し、承認フローの中に「構造化データOK」のチェックポイントを挟むと漏れが激減します。

JSON-LD実装例と構文・警告の対処法

障害の大半は、人手でJSONを作る際の括弧やカンマ漏れ、型ミス(数値を文字列で出力、日付フォーマット不正)に起因します。最初に公式スキーマに準拠した雛形を作り、テンプレからサーバーサイドで自動生成することが王道です。

公開前はリッチリザルトテストや構造化データテスターでエラー/警告を洗い出し、CI(継続的インテグレーション:テストの自動化)でサンプルURLを定期検証する仕組みを用意します。

運用では「エラーは即修正」「警告は内容精査の上、業務影響に応じて優先度付け」が原則です。例えば“推奨項目が未入力”の警告は、ユーザー価値が高いなら早期対応、データ源の整備が要る場合はバックログ化し、フォームやDB拡張で根治します。公開後はGSCの求人インデックスレポートを定期確認し、インデックス済み/未掲載の差分と、クリック・表示の変動を追うと改善のヒントが見つかります。

Google for Jobsに表示されない主な原因

非表示の主因は、技術的構文エラー、必須項目の欠落、タイトル規約違反や過度なSEO表現の混入です。まずはGSCで求人登録数、エラー/警告の有無、表示回数・クリックの推移を確認します。

インデックスされていても露出が少ない場合は、競合の表示差分を観察し、タイトルの語順・定量情報・ポリシー適合性、descriptionの具体性や冗長表現の有無を比較して仮説を立てます。

改善は「公開→GSC確認→競合比較→仮説→修正→再公開」の短サイクルで回し、修正ログを案件IDに紐づけて残すと、再現性のある勝ちパターンが蓄積します。なお、期限切れ求人のvalidThroughや重複URLの扱いが曖昧だと評価を落とすため、終了時のnoindexとサイトマップからの除外、同一求人の評価統合ルールも合わせて設計してください。

重複コンテンツと多拠点の正規化

多拠点・同一求人は重複が発生しやすく、canonical/noindexを含む方針を事前設計することがクロール効率と評価集中の鍵です。

重複対策はクロールバジェットとランキングに直結します。noindexは「確実に除外したい」ページに使い、canonicalは「評価統合のヒント」である点を理解し、目的に応じて使い分けます。同一求人の定義や過去求人と新求人の関係、拠点別ページの差分化までをURL設計と合わせて決めることで、Google for Jobsと通常検索の両輪で拠点別の露出を狙えます。

canonical と noindex の運用ルール

noindexは絶対にインデックスさせたくないページに適用し、これによりクローラーの時間を重要ページに振り向けられます。例として、ニーズの低い複雑な絞り込みや明確な重複一覧、期限切れ求人の詳細などが該当します。

canonicalは評価統合の“ヒント”に過ぎず、常に従われるわけではありませんが、URLパラメータ違い、並び替え差のみのページ、実質的に同一の求人情報を一つに集約したい場合に有効です。

誤用で多いのは、必要なページにnoindexを付けてしまい流入を自ら遮断するケース、内容が異なるページ間で乱暴にcanonical指定をして評価を混乱させるケースです。実務ルールとして、重複が量的に多くクロールバジェットを圧迫している場合はnoindexを優先し、評価を一つに集めたい場合はcanonicalを選びます。

運用時は、サーチコンソールの「ページ」レポートと生ログでnoindexの適用漏れ・誤適用、canonicalの無視・ループを定期診断し、ルールの微調整を続けることが要点です。

同一求人の統合ルールとURL設計例

同一求人の定義を先に固めることが、重複対策の出発点です。職種・仕事内容が同一で拠点のみ異なる場合は、各拠点ページに独自コンテンツ(現場写真、最寄り駅からの導線、シフト実例、マネージャーのコメント、福利厚生の運用差など)を付与して個別インデックスを狙うのが基本設計になります。

職種が異なる場合は独立ページで問題ありません。過去求人と新求人がクエリ的に競合する場合は、過去URL→新URLへcanonicalを向け、期限切れ時にはnoindexを付けてサイトマップから除外することで評価の集中と鮮度維持を両立します。

URL設計の例として、/jobs/{職種}/{拠点-slug}/{job-id}のように人と機械が意味を理解しやすい構造を採用し、パンくずや内部リンクで上位階層との関連も明確にします。これによりGoogle for Jobsと通常検索の双方で、拠点別に露出を広げることができます。

原稿差分化とサブコンテンツでの差別化

差分化はSEOとCVの両面で効きます。最低ラインとしてタイトルと冒頭紹介文は必ず独自化し、共通の企業情報は補助的に位置づけます。

差分の作り方は、部署紹介、同僚の声、1日の流れ、現場写真、社員のキャリアストーリーなど“その職場でしか語れない一次情報”を積み上げることです。AI生成はドラフト作成には有用ですが、事実確認と法令・ポリシー適合の最終チェックは必ず人が行います。

サブコンテンツとして効果が出やすいのは、求人DBから集計したエリア別・職種別の平均給与、残業時間、休日数、離職率などの統計で、一覧やカテゴリに付与すると重複判定を回避しながら滞在・CVを押し上げます。これらをテンプレ化して半自動生成しつつ、定期的に人手で補記・更新するハイブリッド運用が持続可能で実務的です。

ファセット/絞り込みURLとクロール対策

絞り込みの掛け合わせはURLが巨大化しがちなため、公開前にindex方針を明文化し、データを見ながら縮小・最適化してください。

判断は公開前の机上推定だけでは不十分です。初期は広めにURLを公開して実流入を観察し、ニーズの薄い組み合わせをnoindexやrobots.txtで抑制します。重要なのは、クロールを重要ページに集中させる内部リンク設計と、不要URLの事前ブロック・限定公開という運用の仕組み化です。

絞り込みパラメータのindex化判断基準

基本原則は「検索ニーズがある掛け合わせのみindex化」です。公開前の調査ではGoogleキーワードプランナー等を用いて主要クエリの需要を把握し、初期は“エリア×職種”“雇用形態×職種”など主要軸の組み合わせに限定して静的化/インデックス対象にします。

一方、3〜4属性をまたぐ複雑な掛け合わせは、最初からnoindexかrobotsで制御した方がクロールの無駄を防げます。とはいえロングテールはツールに出にくいため、公開後はGSCの検索クエリとランディングを週次で評価し、実際の流入が確認できないURLは順次noindex化・リンク削減で縮小します。

URLパラメータの正規化ルール(順序や重複排除)を決め、重複URLを生まないことも重要です。意思決定はデータドリブンで、定例の削減ボードを持つと継続的に最適化が進みます。

クロールバジェット節約の技術的対策例

最も強力なのはrobots.txtでの不要URL群のDisallowです。これにより“そもそも来させない”を実現できます。noindexは継続的にクロール頻度を下げますが、完全停止ではない点を理解し、併用するのが現実的です。

内部リンクの調整で重要ページへのリンク密度を上げ、不要ページへの露出を抑えると、クローラーの導線が自然に整流化します。

パラメータ多発のサイトでは、URL生成時に規則を持たせ、検索ニーズの確認後に限定的に公開する“後出し静的化”も有効です。大規模サイトではサーバーログでクローラーパターンを可視化し、不要なボットのブロックやアクセス頻度の調整を随時行います。これらを運用に落とし込むため、監視・検知・遮断・検証のPDCAを自動化し、週次で例外レビューを行う体制を構築してください。

一覧ページと詳細ページのテンプレ最適化

タイトル・H1・メタディスクリプションのテンプレを統一し、一覧はUX最優先、サブコンテンツで差別化してSEOとCVを両立させます。テンプレは“量産の質”を担保します。タイトル型の確立、H1の簡潔化、meta descriptionのクリック設計、原稿の冒頭要点テンプレ、一覧の差別化サブコンテンツの用意までをセットで整えます。大量運用では、テンプレ×自動検証が効率を劇的に高めます。

タイトル・H1・meta descriptionの設計テンプレート

成果が出るタイトルは、検索語を自然に含みながら、CTRを押し上げる定量要素(給与、雇用形態、エリア、勤務時間帯など)を織り込みます。

例として「渋谷のカフェ店長|正社員|月給28万〜|経験者優遇」のように、職種・エリア・形態・給与の骨子を崩さず、過剰な装飾は避けます。NGは、業態や職種が不明瞭なキャッチコピーのみのタイトルで、意図と一致せずクリックを逃します。

H1はページ内容を端的に示し、meta descriptionは“何がわかる/何が得られる(給与・時間・休暇・応募条件)”を短く整理してクリックを誘導します。情報はタイトルに詰め込み過ぎず、ディスクリプションへ適切に分散すると、検索スニペットでの理解が進みます。テンプレ化し、入稿時にプレビューと文字数・禁則チェックを自動実行することで、現場でも再現性の高い品質を維持できます。

求人原稿テンプレ(冒頭要点・必須項目)

冒頭で「職種・雇用形態・勤務地・想定給与」を必ず明示し、候補者が“合う・合わない”を瞬時に判断できる構成にします。本文の必須項目は、タイトル/勤務地/雇用形態/給与範囲/業務内容/必須スキル/歓迎スキル/勤務時間/福利厚生/応募方法の順で、応募を阻む情報不全を無くします。

CVにつながる原稿は、募集背景、配属部署のミッション、1日の流れ、評価制度、育成/シフトの柔軟性など“意思決定に効く情報”が充実しています。AI生成は叩き台として有効ですが、ヒアリング不足や事実誤りが混入しやすいため、編集ガイドラインと二重チェックを必須化し、写真・図版も原稿の理解を補う形で配置します。

Indeed等のアグリゲーターでも原稿品質は評価に影響するため、テンプレで基礎品質を上げることが、チャネル横断の成果にも波及します。

一覧ページに効くサブコンテンツと設計例

一覧は求人カードの羅列だけでは重複判定を受けやすく、UXも単調になりがちです。差別化には、エリアや業種の平均給与、残業時間、週末シフト比率、掲載求人からの統計、採用トレンドの短評など、データ起点のサブコンテンツが有効です。これらは求人DBから自動集計して簡潔な解説を添え、都度更新される動的領域として設計します。

UX面では、主要フィルタを上部に固定し、パンくずと関連カテゴリ導線で“次の一手”が明確なレイアウトにします。内部リンクは、カテゴリ上位→一覧→詳細の往復導線を最適化し、人気求人や急募への文脈リンクを加えると、回遊とクロールの両面で効きます。

サイト構造・内部リンク・サイトマップ運用

内部リンクで重要ページへ評価とクロールを集中させ、サイトマップは一覧/詳細で分割し、GSCで粒度別に監視します。構造は“辿りやすさ”と“分析しやすさ”が命です。パンくずの構造化マークアップ、サイトマップの戦略的分割、GSCでの監視ポイントを定義し、異常検知から原因追及までを手順化します。

パンくず・XMLサイトマップ分割と管理方針

パンくずはschema.org/BreadcrumbListで構造化し、UX観点で上位階層(地域か職種か、掛け合わせか)をユーザーの探し方に合わせて設計します。入口となる主要ディメンションを明確にし、パンくずとサイト内検索、関連カテゴリの導線を一致させると、ユーザーにもクローラーにも一貫した構造を示せます。

サイトマップは一覧ページ、詳細ページ、静的/ナレッジの3分割以上を基本とし、GSCに別送してインデックス状況を粒度別に把握します。これで「どのタイプが詰まっているか」を即時に診断でき、優先順位を付けた改善が可能になります。

大規模サイトの運用では、内部リンクは“重要カテゴリ群→新着/人気→詳細”への流れを強化し、重要でないフィルタ結果や低品質ページ群からのリンクを意図的に弱める設計が有効です。

サイトマップ更新頻度とGSC監視の実務方法

サイトマップの更新頻度は“ページ更新の実際のタイミング”で動的反映するのが理想です。新規求人の公開、求人終了、重要情報の変更が発生したら即座に該当サイトマップを更新します。

監視の要点は、サイトマップ別のインデックス率、クロール済み/未インデックスの偏在、URLごとのエラー傾向です。異常が見つかれば、サーバーログでクロール到達と応答時間、ステータスコードを突合し、テンプレ/構造化データ/内部リンクのどこで詰まっているかを切り分けます。週次のモニタリングに加え、急増・急減のしきい値でアラートを設けると、障害の早期検知と復旧が実現します。Indexing APIは重要求人の即時反映に限定して活用し、乱用は避けます。

運用KPIと計測ダッシュボード設計

重要ページとクエリを定義し、クロール→インデックス→ランキング→CVの各段階でKPIを設け、ダッシュボードで可視化します。ローンチ期はクロール/インデックス優先、安定期は流入最大化とCV最適化へ舵を切るのが定石です。段階ごとに指標と閾値、担当と対応優先度を決め、意思決定の速度を高めます。

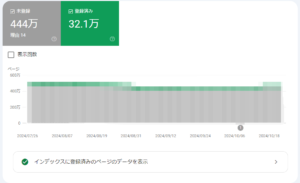

クロール・インデックス・ランキングのKPI例

クロールでは重要URLのクロール有無と頻度、応答時間を追い、サイトマップ粒度での分布も可視化します。

インデックスはサイト全体とサイトマップ別の登録数、未登録理由の内訳、公開から登録までの遅延日数が鍵です。

ランキングは重要クエリの平均順位と表示回数、CTR、ランディングページ別の直帰率/滞在を併せて評価し、CVはページ種類別の応募数、応募率、JobPostingの登録数・表示・クリックを見ます。

フェーズ別には、ローンチ~拡張期でクロール/インデックスを重視し、安定期に入ったらサブクエリや新カテゴリの開拓で裾野を広げ、CVボトルネック(フォーム、情報欠落、動線)を潰す運用が成果を安定化させます。可視化はGA4とGSC、自社ログを統合し、日次・週次・月次のレビュールールを設計します。

サーバーログとGSCを使った優先課題の洗い出し

サーバーログではURLパターン別にクロール頻度、ステータスコード、応答時間、User-Agentを可視化し、重要ページの未クロールや高遅延を即座に特定します。GSCのクロール統計では全体のリクエスト推移、応答時間のトレンド、レンダリング問題の兆候を掴み、サイトマップと「ページ」レポートで未インデックスの増え方をチェックします。

優先度は検索ボリューム×CV貢献でスコア化し、影響の大きいパターンから順に改善します。改善は「不要クロールの遮断→重要ページへの内部リンク強化→テンプレ/構造化データ修正→再検証」の順で手を打つと、短期と長期の効果が両立します。定例の“ログ×GSC合議”で、属人的な判断を排し、数字で意思決定するカルチャーを根付かせることが長期の勝ち筋です。

※弊社NYマーケティング株式会社では、生ログを分析するツールを自社開発しています。このツールを用いてログ分析を効率化し、最速でクロール改善に活かしています。

NYマーケティングの求人サイトSEO支援事例

業種別・課題別に設計と運用を行い、初期設計の徹底、原稿のマニュアル化、内部リンク最適化、クロール監視が共通の成功要因でした。不動産、女性向け、飲食の3例を紹介します。いずれも“基礎体力=SSRとテンプレ×自動検証”を固め、データで改善を回すことで、厳しいカテゴリでも上位露出と応募増を実現しています。

不動産求人サイト

不動産系はエリアと職種の掛け合わせ需要が強く、マスター設計とカテゴリ体系のブレがUXとクロールの両方を阻害します。支援プロジェクトでは、CMSの不具合検知と修正から着手し、一覧・詳細テンプレを刷新、JobPostingの自動生成と構造化データ検証を運用オペレーションに組み込みました。

求人原稿の運用マニュアルを策定し、タイトルの定量要素ルール、冒頭要点の必須記載、写真・現場情報の差分化を義務化。内部リンクはエリア×職種の主要軸に集約し、低需要の掛け合わせはnoindexで抑制。結果として、競合が厚いエリアでも複数クエリで上位化、自然検索経由の応募数が安定成長しました。初期設計の徹底と原稿品質担保、そしてクロール監視の三点セットが奏功しました。

女性向け求人サイト

女性向けサイトでは、シフトや雇用形態、福利厚生など属性の掛け合わせが多く、階層深度が深くなるとロングテールがクロール不足に陥ります。

優先クエリを定義し、内部リンクで“重要カテゴリ→注力一覧→詳細”の導線を強化。掛け合わせの中で実流入の薄いものはnoindex/robotsで制御しました。ユーザーインタビュー(UGC:User Generated Content)を定期実施し、原稿の冒頭要点、写真の選定、FAQの追加、応募前の不安解消コンテンツを反映。

GSCと生ログで週次モニタリングし、クロールの偏在や応答遅延を検知・是正しました。結果として流入と応募率の双方が改善し、特に“働きやすさ系”サブクエリの露出が増加。データに基づく縮小・集中とUX起点の情報補完が鍵でした。

飲食店求人サイト

飲食は募集の回転が速く、採用難易度が高い分だけ原稿品質と露出速度がKPIを左右します。SEOコンサルティングの支援では、現場取材を運用に組み込み、写真・1日の流れ・シフト柔軟性・賄い/住宅手当など意思決定に効く情報をテンプレ必須化。

テクニカル面はサイトマップ分割、内部リンク最適化、クロール制御で改善速度を上げました。JobPostingは推奨プロパティまで段階的に拡張し、GSCでの表示・クリックを週次で追い、タイトルの定量要素と語順をABテスト。結果として、上位露出の拡大と応募CVRの改善が両立。継続的に品質の高い原稿を確保する体制づくりが、テクニカルSEOの効果を底上げしました。

よくある問題と優先改善リスト

大規模サイトほどクロールが回らない問題が致命傷になります。ログとGSCで根因を特定し、クロール/インデックス直結の施策から順に着手しましょう。短期で効く遮断・集中と、長期で必要な仕組み化を分けて取り組むのが実務のコツです。JobPostingの検証フローは“自動化”で人的ミスを減らすと安定します。

クロールが回らない時の優先対応項目

初動はサーバーの生ログを自社の分析基盤に取り込み、URLパターン別のクロール有無と頻度、応答時間、ステータスコードを可視化します。重要URLの未クロールや高遅延が確認できたら、まずrobots.txtで不要なクロールをDisallowし、クロール予算を重要ページへ振り向けます。

次に、オーファン化(内部リンクがない孤立ページ)した詳細への内部リンクを一覧・関連記事から補強し、サイトマップの更新遅延があれば即時修正。長期対策は、週次の生ログ監視としきい値アラート、テンプレの継続改善(構造化データ、メタ、パンくず)、サーバーやキャッシュ構成の最適化です。

JobPostingエラー・警告の典型的対処法

頻出の不具合は、JSON-LD構文ミス、必須プロパティ欠落、データ型の不一致です。対応の優先順位は明確で、エラーは即修正、警告は内容を精査してCVや表示に直結しないものは後回しにできますが、バックログ化と対応担当者の明確化は必須です。

フローは、入稿→自動生成→事前検証(リッチリザルトテスト)→公開→GSC監視→エラー検知→自動通知→修正→再検証を繰り返し、警告のうち“推奨プロパティ不足”はデータ源(フォーム、DB)拡張の計画に落とし込みます。タイトル規約違反や誇大表現はポリシー面の監修が必要で、編集ガイドラインとサンプル集を整えると再発が激減します。定例で“未掲載→掲載化”の成功パターンを共有し、テンプレ側へ知見を反映すると改善スピードが増します。

付録:実務で使えるツールとリソース集

日常運用の中核はGSC、GA4、自社生ログ分析ツール、リッチリザルトテスト、クロール/インデックス一括チェックツールの併用です。KPI別に使い分けましょう。

クロール分析はGSC+クロール/インデックス一括チェックツール(https://valentin.app/inspect.html)+生ログ、インデックスはGSCとリッチリザルトテスト、ランキングはGSC/GA4/順位計測、CVはGA4/応募DBの統合が基本線です。

構造化データ検証・GSC・Indexing APIなど

構造化データの検証はリッチリザルトテストとGSCを併用し、公開前後の差分を記録しておくと因果が追いやすくなります。Indexing APIは、更新頻度が高く、即時反映の価値が大きい“重要求人”に限定して活用し、普段はサイトマップ自動更新と内部リンク最適化で十分に回ります。

平時の運用は、GSCの「ページ」「求人インデックス」レポートでサイトマップ別の状況を監視し、クロール/インデックス一括チェックツール(https://valentin.app/inspect.html)で新規/修正URLの即時チェック、生ログで実際のクロール到達と応答を突合させます。

まとめ:応募数を安定化する施策と支援案内

応募数の安定化は、クロール→インデックス→ランキング→CVの各段階を継続改善し、SSR・構造化データ・原稿品質・UXなど必要な要件を抑えて運用することが要諦です。

総括として、初期はSSRとテンプレ×自動検証を整え、GSCと生ログで初動のクロール/インデックスを監視する体制が不可欠です。大規模化するほどクロール監視の重要度は上がり、ここが崩れると流入もCVも下振れします。

中長期では、原稿品質とUXを並走させ、JobPostingの推奨プロパティ拡張とタイトル/説明のCTR改善を積み重ねるのが王道です。

AI/SGE時代には、JS依存を避けたSSR、正確な構造化データ、一意な一次情報の蓄積が、AI露出と自然検索の両面で勝ち筋になります。

当社NYマーケティングは、初期設計、JobPosting実装、クロール監視体制、原稿品質改善まで包括支援を提供しています。まずは現状診断からお気軽にご相談ください。

| 段階 | 重点タスク | 検証手段 | PDCA周期 |

|---|---|---|---|

| クロール | robots整備/内部リンク集中/サイトマップ分割 | 生ログ・GSCクロール統計 | 週次・月次で解消 |

| インデックス | JobPosting検証/Indexing API(限定) | GSC求人・ページレポート | 重要URLは48h以内 |

| ランキング | タイトル/説明最適化/差分化サブコンテンツ | GSCクエリ・CTR | 四半期で改善率評価 |

| CV | 原稿テンプレ強化/UX改善/フォーム最適化 | GA4・応募DB | 月次でCVR+X%維持 |

“求人はスピードと真実性”。SSRで速く正しく届け、一次情報で独自性を築く。仕組み化された検証と改善が、応募の再現性を生みます。