この記事では「インデックス数」の定義から、Search Consoleを使った確認手順、トラブルの優先対応、実務フローと回復事例、よくある質問までを実務視点でわかりやすく解説します。

新規公開後の検出不足や既存サイトでの急減など、現場でよく遭遇するケースごとに短期対応と中長期の対策も提示。まずは現状把握の手順を実行し、優先度の高い修正から取り組みましょう。

▼この記事を動画で見る

インデックス数の基本と検索の流れ

インデックス数は単なる「ページ数」ではなく、検索エンジンが検索対象として登録したURLの数を示す指標であり、サイトの発見性と評価プロセスに直結します。インデックスの増減はクロール・robots/noindex・canonical設定・サーバー状況・コンテンツ品質など複合的要因の結果であるため、数値を見て即座に原因を特定するのではなく、ログやGSCデータと突合せて切り分けることが重要です。

インデックス数の定義と重要性

インデックス数とは、Googleをはじめとする検索エンジンが「検索対象」として自社データベースに登録しているURLの総数を指します。単に公開しているページが多いこととインデックス数が多いことはイコールではなく、重要なのは検索に出せる(=ユーザーの目に触れる可能性がある)ページがどれだけ存在するかです。

Search Consoleの「カバレッジ」やURL検査、サイトマップ到達率で「有効」としてカウントされているURL数を把握し、同時に「除外」タブで何が除外されているか(noindex、robots、重複、品質など)を定期的に監視する運用が基本になります。特に大量の低品質ページを放置すると、検索全体での評価やクロールの割当(クロール予算)に悪影響を与える可能性があるため、インデックス対象の取捨選択を設計・運用として明確にすることが求められます。

具体的には、テンプレート誤配置でnoindexが付いていないか、意図しない重複ページが存在しないかを優先的に確認し、必要に応じてnoindexによる整理や正規化(canonical/301)を行うべきです。

クロール→インデックス→ランキングの仕組み

検索エンジンの処理は大きく「クロール(発見)→インデックス化可否判定→ランキング用インデックス登録」の順で進みます。まずGooglebotなどのクローラーがサイト内のリンクやサイトマップを通じてURLを発見し、次にそのURLがrobotsやmeta noindex、canonical指定、ページ品質チェックによりインデックス可否を判定します。

ここで「検出-インデックス未登録(Discovered but not indexed)」や「クロール済み-インデックス未登録(Crawled – currently not indexed)」というステータスは重要なシグナルで、前者は発見はされているが検査が追いついていない/クロール頻度の問題、後者はクロールはできているが品質判定で保留されている可能性が高い、という切り分けに使えます。

加えて、サーバーの5xxエラーや大量の404/ソフト404はクロール時の負荷や信頼性を下げ、結果としてインデックス登録の阻害要因になるため、ログ監視と速やかな修正が必要です。こうしたフローを理解すると、インデックス数の増減を見た際に「発見不足」か「品質問題」かを的確に判断し、優先度高く対応できます。

Search Consoleでの確認方法

GSC(Google Search Console)はインデックス数を直接確認できる第一の情報源で、カバレッジ・URL検査・サイトマップ到達率・robotsテスターなどを組み合わせて現状の把握と原因切り分けを行います。まずはカバレッジの推移と除外理由を見て、急な変化があればデプロイやrobots更新履歴と照合しましょう。

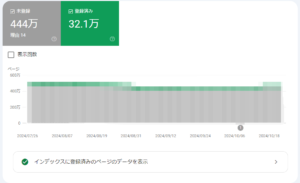

カバレッジで見るべき項目と解釈基準

カバレッジの「有効」タブでインデックス数の推移を把握し、増減のタイミングを日付ごとに確認するのが基本です。増減が急であれば、その日付に行われたデプロイ、robots.txtの変更、テンプレート差し替え、または意図せぬnoindex一括適用など運用上の変更履歴と突合せると原因特定が早まります。

また「検出-インデックス未登録」や「クロール済み-インデックス未登録」はそれぞれ「発見はされているが検査/クロールの余剰待ち」「クロールはされたが品質評価で保留」の可能性を示すため、優先対応のヒントになります。サーバーエラー、リダイレクトループ、404/ソフト404、サイトマップ到達率の差異はインデックスに影響するため、これらの項目が増加していないかを常に監視し、ログでクロール頻度と応答状況を確認する運用にしてください。

URL検査の使い方とチェックポイント

個別URLの状態確認にはURL検査が最も有効です。URLを入力するとGoogleがそのページをどのように認識しているか、インデックス状況・適用canonical・robotsによるブロック・レンダリング結果などを一度に確認できます。インデックスされていない場合は、表示されるステータス(blocked by robots, noindex, redirect, discovered but not indexed など)を読み取り、原因に応じた修正を行うのが次のステップになります。

修正後は同じURLを再度URL検査に投入し、「インデックス登録をリクエスト」して再クロールを促しますが、この操作は即時反映されるわけではなく数日〜数週間かかることがあるため、カバレッジとサイトマップ到達率を定期的に監視して効果を確認してください。大量のURLが未登録の場合は代表的なサンプルを選び修正→再申請の流れで効率的に進めるのが実務上のコツです。

インデックス登録リクエストの手順

インデックス登録を効率よくリクエストする実務手順は、まずURL検査で現在のステータスを確認し、必要な修正(noindex除去、robots修正、canonical調整、コンテンツ改善、404修正など)を行うことです。修正が完了したら再度URL検査にそのURLを入れ、「インデックス登録をリクエスト」を実行してGoogleに再クロールを促します。大規模に修正を行った場合はサイトマップを更新して再送信し、到達率の改善をモニタリングしてください。反映には時間がかかるためGSCのカバレッジとアクセスログを数日ごとに確認して変化を追い、改善が見られない場合は修正内容の再確認と別の代表URLでの検査を繰り返すことが重要です。

優先度付きトラブルシューティング

インデックス問題を解く鍵は「影響度の高い事象を先に潰す」ことです。robotsやサーバーエラーなどの即時対応案件は最優先にし、品質改善やコンテンツの整理は中長期の改善として計画的に実行します。

robots.txt と noindex の確認と修正

まずはrobots.txtで重要なページが誤ってブロックされていないかを確認します。GSCのrobots.txtテスターや実際のアクセスログでGooglebotからのアクセスがブロックされていないかを検証し、もし誤ブロックがあれば速やかに修正して再公開します。次にテンプレートやCMS設定でnoindexが大量に付与されているケースがないか、特にステージング環境の設定が誤って本番に適用されていないかをチェックします。

noindexは限定的に使えば有効ですが、テンプレート誤配置で多数ページに一括適用されると大きな被害につながるため、noindexとcanonicalの整合性や運用ルールをドキュメント化して一貫性を保つことが重要です。修正後は対象URLでURL検査→インデックス登録リクエストを行い、GSC上で反映を確認してください。

XMLサイトマップ送信と検証の手順

XMLサイトマップはGoogleに対する「発見の案内状」です。サイトマップには必ず正規(canonical)URLのみを含め、noindexや除外対象のURLは混在させないことが基本です。サイトマップは50,000 URL / 50MB の制限に留意して分割・分類し、各ファイルのlastmodを適切に更新してGSCへ送信します。GSCに送信後は到達率(送信したURLのうちGoogleが到達し検査した割合)を定期的に確認し、到達率が低下している場合は発見不足の可能性があるためログと内部リンク構造を見直します。パラメータ付きURLや重複URLが混ざっていると到達率が下がるため、生成ロジックやCMSの出力を点検して整合性を保つことが重要です。

canonical・重複コンテンツの検出と対応

同一または極めて類似したコンテンツが複数URLで存在すると、Googleはどれか一つを選んでインデックス化し、残りを除外する傾向があります。自己を正規化(self-canonical)するポリシーを徹底し、同時にcanonicalとnoindexを併用して矛盾が生じないように設計しましょう。重複判定はGSCの除外理由(重複による除外)やサーバーログ、サイト内のパラメータ設計を確認することで検出できます。

対処は方針に基づき、301リダイレクトで統合するかcanonicalで正規URLを指定するか、または薄い一覧やファセットページはnoindexにして正規コンテンツへの内部リンクを集約するなど、ケースごとの標準フローを定めておくと現場での迷いが減ります。

重複判定の実務フローと対処例

実務ではまずGSCの除外理由を取得し、除外理由に基づいて重複候補を抽出します。抽出後はコンテンツの実態を確認し、方針に従ってcanonical/301/noindexのいずれかで統一します。例えば、パラメータ付きの一覧ページが複数ある場合は、一覧の代表URLを正規化し、他をnoindexにした上で内部リンクを代表URLへ集約するのが有効です。

同一コンテンツが複数ドメインやサブドメインに存在する場合は一貫した正規化戦略(メインドメインに統一して301を使う等)を適用してください。内部リンクとサイトマップの整備を行い、再度GSCのカバレッジで改善を確認することで、重複による不必要な除外を減らせます。

内部リンク・クロール最適化の改善策

クロール発見性を高めるためには重要ページへの内部リンクを意図的に増やし、サイト構造をフラットにしてクロールの深さを浅くすることが有効です。トップページやカテゴリページから重要なページへ確実に到達できる導線を設計し、パンくずや関連記事、カテゴリーページで内部リンクを補強します。また内部検索結果やフィルタ/ファセットページは原則noindexにしてサイトマップや内部リンクに含めない運用を徹底し、必要な検索用途は専用ランディングページに切り出してindex可能にする設計が望ましいです。

大規模サイトではクロールバジェットを意識して不要ページをrobots/noindexで整理し、重要ページにクロールを集中させる仕組みを作ることが成果を早く出すコツです。

ケース別の短期対応フロー

状況に応じて優先タスクを定め、影響度の高いものから順に対処していくのが最短での回復法です。ログ・GSC・デプロイ履歴を突合せて原因特定を速やかに行い、即時対応(robots/server)と中期対応(品質改善)を並行して進めます。

新規公開サイトがインデックスされない時

新規サイトや新規ページがインデックスされない場合はまずrobots.txtとページにnoindexが付与されていないかを最優先で確認し、もしブロックされているなら速やかに修正します。次にSearch Consoleにサイトを登録し、XMLサイトマップを送信して検出を促すとともに、トップページやカテゴリページからの内部リンクで新規ページへの導線を作ります。

少数の代表ページでURL検査→インデックス登録リクエストを行い、Googleの反応を見てクロール頻度や品質評価の傾向を判断してください。検出がされない場合はサイト公開直後のクローラブルなリンク構造を見直すこと、品質基準を満たしているかどうかの目視チェックが有効です。

既存サイトでインデックス数が急減した時

既存サイトでインデックス数が急減した場合はまずGSCのカバレッジで該当日付に発生しているエラー種類(robots, server error, manual action, security issues など)を確認します。急減が見られる日付とサーバーやデプロイ、設定変更の履歴(robots更新やCMSのテンプレート変更、.htaccess修正など)を突合せることで多くは原因が特定できます。

重大なブロックが見られない場合は代表URLをURL検査で検査し、必要があれば「インデックス登録をリクエスト」を行い、サイトマップ到達率やアクセスログでクロール頻度の低下がないかを確認してください。問題が断続的であれば一時的なサーバー負荷やGoogle側の処理遅延の可能性もあるため、継続的な監視とログ保存を行って根本原因を追います。

大規模サイトの特有リスクと対策要点

大規模サイトではパラメータ、ファセット、内部検索、薄い一覧ページなどがインデックスの阻害要因になりやすく、方針の曖昧さが問題を複雑化させます。まずはどの種類のページをindex対象とするかを文書化し、サイトマップを分割・分類して送信、lastmodポリシーや更新頻度に応じた運用を行って到達率を監視します。

ログとGSCを組み合わせたダッシュボードを作り、到達率やクロール比をKPIとして定期レビューすることで発見不足と品質問題を切り分けられるようになります。優先順位はクロール頻度が高くトラフィック影響度の大きいページから改善を行うと効果が出やすいです。

実例:原因と修正による回復事例

実務で効果があった具体例を示すことで、原因特定から修正、そして回復までの流れをイメージしやすくします。類似事例を社内でナレッジ化すると再発防止に繋がります。

事例1:noindex設定ミスの修正例

あるサイトでテンプレートの誤設定により重要な多数のページが誤ってnoindex化され、インデックス数が急減しました。対応はまずテンプレート修正でnoindexを除去し、代表的な修正済みURLでURL検査→インデックス登録リクエストを行い、併せてサイトマップを更新して再送信しました。結果として数日から数週間で徐々にインデックスが回復しました。実務ではnoindexを外すだけでなく、canonicalの整合性と内部リンクの再確認を同時に実施することで、再発のリスクを下げられます。

事例2:サイトマップ再構成で回復した例

別の事例では、サイトマップに古いURLやnoindex対象の大量のURLが含まれていたため到達率が低下し、検出機会が減少していました。対応としてサイトマップを正規URLのみで再生成し、ファイルを分割してlastmodを整備、GSCへ再送信したところ到達率が改善し、クロール数が回復してインデックス数が増加しました。大規模サイトではサイトマップを論理的に分割して送信することが検出効率を高める有効手段です。

事例3:内部リンク改善で増えた例

あるECサイトで重要ページが孤立しており、発見性が低くなっていたためインデックスされない状況が続いていました。対処としてカテゴリーページと関連記事、パンくずなどを見直し、重要ページへの内部リンクを意図的に増やしたところ、クロール経路が改善されてインデックス数が増加し、対象キーワードでのオーガニック流入も回復しました。内部リンクは単なる導線改善だけでなく、クローラーにとっての優先度シグナルにもなるため、戦略的に設計することが重要です。

よくある質問(FAQ)

実務でよく出る疑問と短く明確な回答をまとめ、迷ったときに参照できるようにしています。まずはGSCでの現状把握を最優先に動いてください。

インデックス数とは何ですか?

インデックス数は、Googleがインデックス(検索対象)として認識・保有しているURLの数を指します。重要なのは量だけではなく質で、質の低いページをむやみにインデックスさせるとサイト全体の評価へ悪影響を及ぼす場合があります。そのため記事数を増やすだけでなく、どのページをインデックスさせるかの運用ルールを設け、noindexによる整理やページ統廃合を行うことが必要です。まずはGSCのカバレッジで「有効」と「除外」を確認し、何が除外されているのかを把握することから始めましょう。

Search Consoleでどこを見れば良い?

効率的な確認順はカバレッジ(インデックス推移・除外理由)→URL検査(個別確認)→サイトマップ(到達率)→robots.txtテスターの順です。カバレッジで全体像を掴み、問題の発生した日付とエラー種別を見つけたら、URL検査で代表URLの詳細を確認して原因を切り分け、サイトマップとrobotsの修正を行います。これらを組み合わせることで短期の原因特定と中長期の改善方針が明確になります。

noindexやrobots.txtで弾かれているか確認するには?

該当URLをGSCのURL検査に投入すれば、robotsによるブロックやmeta noindexの有無、適用canonical、レンダリング結果などが確認できます。サイト全体の傾向を把握するにはカバレッジの「除外」タブを見て、どの理由で除外されているのか一覧で確認するのが早道です。robots.txtは無料公開されているいくつかのテスターで構文チェックとアクセス可否の検証ができるため、運用変更時は必ずテスト環境で検証してから本番適用してください。

インデックス数が増えない優先対策は?

まず発見性の確保(XMLサイトマップの送信、内部リンク強化)を行い、次にブロック要因(robots/noindex/server error)を排除、最後に品質改善(薄いページの統廃合)に着手するのが効率的です。ログ解析で「必要なページに対するクロール比」と「不要なページのクロール比」を把握し、不要なクロールを減らして重要ページへクロールを集中させることが早期改善に繋がります。

まとめ:インデックス改善と当社支援案内

インデックス数の改善は「発見性確保→ブロック排除→品質改善」の順で進めるのが基本で、GSC・サイトマップ・ログを組み合わせた定量的な切り分けが鍵になります。当社では初期診断(GSC・サイトマップ・ログ解析)、優先度付き改善計画、実装支援(robots/canonical/サイトマップ/内部リンク修正)、効果測定レポートまで一気通貫で支援可能です。

まずはGSCの権限付与または診断用データ共有をお願いいたします。共有をいただければ短期間で優先課題を洗い出し、具体的な対応プランを提示します。

| 状況 | 即時対応 | 中期対応 |

|---|---|---|

| インデックス全体急減 | GSCカバレッジ確認、robots/serverエラー修正 | テンプレート検査、noindexポリシー見直し |

| 新規ページが検出されない | robots/noindex確認、サイトマップ送信 | 内部リンク設計、品質改善 |

| 発見はあるが未登録 | 代表URLでURL検査→インデックス登録リクエスト | コンテンツ品質の向上、クロール予算管理 |

次のアクション:まずSearch Consoleでカバレッジの「有効」と「除外」を確認し、5件程度の代表URLでURL検査→問題の洗い出しを行ってください。解析が必要な場合は当社が診断サポートをいたします。