データベース型サイトは、テンプレートにデータを差し込みながら数千〜数十万ページを自動生成するため、記事型のSEOと比べて「設計・運用・監視」の総合力が結果を左右します。

本記事では、クロール予算の最適化、インデックス戦略、内部リンクによる評価循環など、成果に直結する10の要点を現場目線で体系化。設計時の技術要件から、ログ起点の運用、テンプレ最適化、ダッシュボード運用までを、実務フローとチェック観点に落とし込みます。

はじめての方でも迷わない優先順位と段階的アプローチを明示し、短期改善と長期成長の両立を狙える実践手順を解説します。

データベース型サイトとは何か

テンプレート+データで大量ページを動的生成するDB型は、記事型と異なり「設計=SEO施策」の色合いが強くなります。ポータル、求人サイト、ECなどの大規模サイトに多く、ページ規模に応じてクロールやインデックスの考え方が大きく変わる点をまず掴みましょう。

記事型との違いと代表的なWebサイト

記事型は1ページ1記事を手作業で作成するのが基本で、全体規模は数十〜数百ページに収まることが多く、個別記事の質とトピック選定が成果を左右します。対してデータベース型は、共通テンプレートにレコード(商品、店舗、求人、物件、レビュー等)を差し込む設計により、同一の枠組みから数千〜数十万ページを一気に展開できるのが特徴です。

代表的なユースケースは、飲食や不動産などのポータル、求人メディア、ECモールで、検索ニーズ(例:エリア×カテゴリ、ブランド×仕様、職種×勤務地)とデータ設計が直結します。DB型の本質は「大量の自動生成ページを、検索意図と情報構造でどう価値化するか」にあり、テンプレ階層、内部リンク、構造化データ、パラメータの許可・除外基準など、実装前の要件定義がすぐに成果へ跳ね返ります。

たとえば求人サイトなら、実際に検索される「地域×職種×雇用形態」などの組み合わせのうち、ユーザーニーズがあるものに限定してインデックスさせる戦略が、クロールの集中と評価の集中を同時に達成します。この「データ=情報設計」の思想こそが、記事型と根本的に異なる成功条件です。

DB型が抱えるSEO特有の課題

DB型はスケール性が魅力である一方、クロール予算の分散、薄いページの量産、ファセットやパラメータの組み合わせ爆発、重複コンテンツなど、規模に起因する固有の課題を抱えます。

まず重要なのはクロール最適化で、重要テンプレートにクロールを集中させる設計と運用が不可欠です。薄いページが大量に存在するとサイト全体の評価が曇るため、統合・削除・noindex・canonicalを明確なルールで使い分けます。

UX上は必要だが検索価値が低いページはnoindexで残す判断を仕組みにします。さらに、パラメータの無差別な許可はURL爆発の温床となるため、検索ニーズのある組み合わせだけをホワイトリスト化し、その他は自動的に正規化やnoindexに落とし込む運用が必須です。

これらはSEO担当だけでは完結せず、エンジニアリングとプロダクト運用の協働で初めて機能します。評価の立ち上がりは時間がかかるため、初期の合意形成と段階的なKPI設計を行い、短期(robots.txtや内部リンク)と中長期(テンプレ更新、SSR化)を併走させる計画が現実的です。

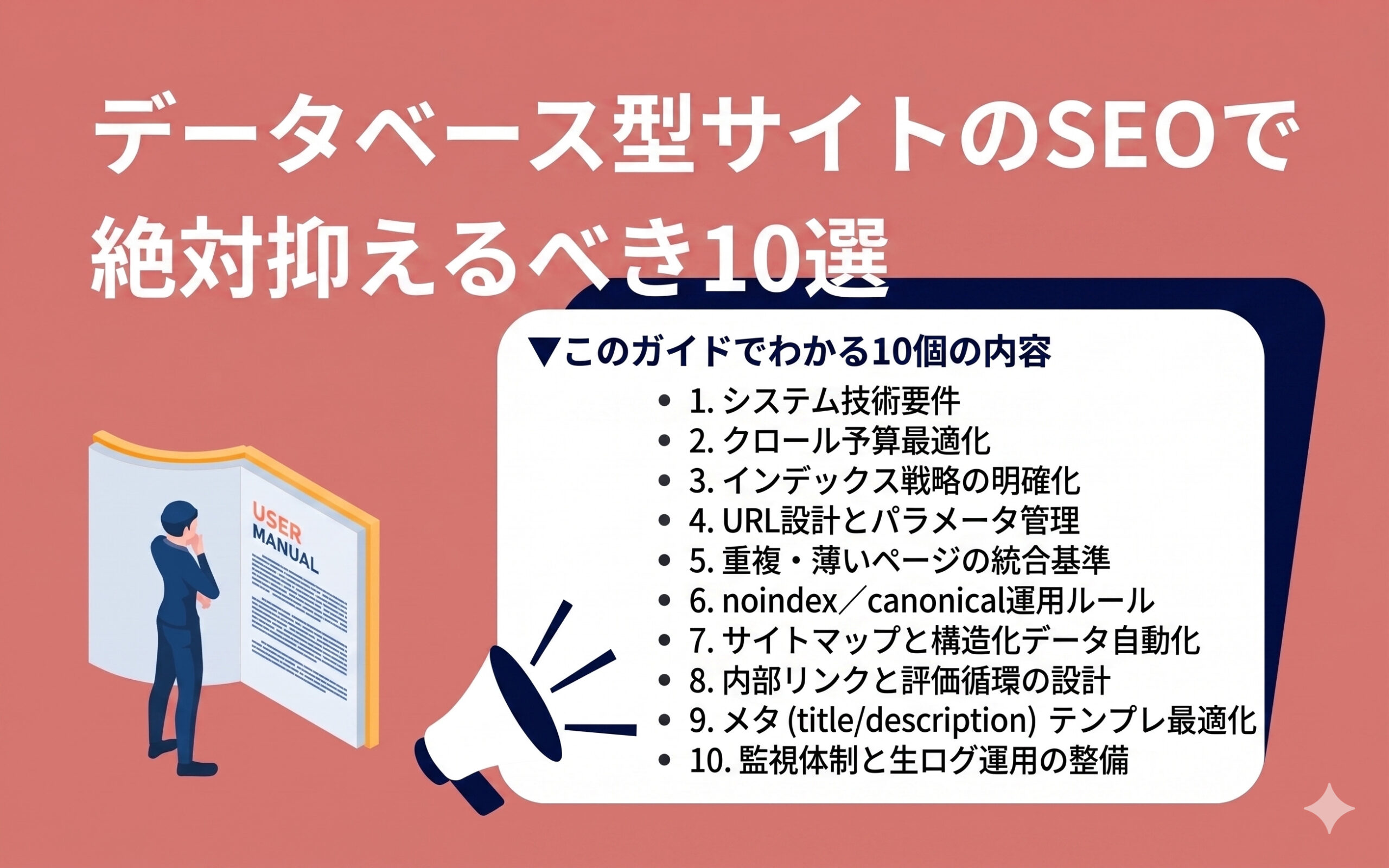

DB型SEOで絶対抑えるべき10選

DB型SEOの要点は「1)システム技術要件 2)クロール予算最適化 3)インデックス戦略 4)URL/パラメータ管理 5)重複・薄いページ対応 6)noindex/canonical運用 7)サイトマップ・構造化データ自動化 8)内部リンクと評価循環 9)メタテンプレ最適化 10)監視体制と生ログ運用」。特に2・3・8が成果の要。初心者はシステム技術要件で”Javascriptレンダリング”前提の設計に流れがちなので要注意です。

1. システム技術要件

DB型は「設計の一手」が後工程のすべてに波及します。SEO要件をエンジニア・プロダクトと同一ドキュメントに統合し、テンプレ単位での要件定義、検証フロー、例外ルールまでを言語化してブレを防ぎます。初期での技術的妥協は後から何倍もの手戻りを生むため、最初が肝心です。

サーバーサイドでHTMLを出力する設計

SSR(サーバーサイドレンダリング)を原則に据えると、クローラーとLLM系ボットに対して「確実に解釈可能な完全HTML」を返せます。これにより、JSレンダリングの不確実性に依存せず、インデックスの遅延や欠落を回避できます。

実務では、テンプレートごとにSSR必須領域(title/meta/構造化データ/本文/パンくず/内部リンク)を定義し、例外は「ユーザー操作依存の動的UIのみ」として明示します。既存サイトがCSR(クライアントサイドレンダリング)寄りなら、ビジネスインパクトの大きいテンプレ(TOP/カテゴリ/一覧/詳細/主要ハブ)から段階的にSSR化する計画を立て、プリレンダリングや静的生成とのハイブリッドで移行リスクを抑えます。

Javascriptレンダリングを採用しない

GoogleはJS対応を表明していますが、実務レベルで100%の安定を期待するのは危険です。特にDB型で重要な検索向け要素(構造化データ、title/description、本文の主要部分)をJSに委ねると、クロールタイミングやレンダリング制約によりインデックスや評価が不安定になりがちです。

さらに、LLM系ボットや一部検索エンジンはJSを十分に実行しない前提で設計すべきで、SEOに直結する領域は「JS非依存」を原則に据えます。どうしてもCSRが必要なUIは、検索用に静的なメタ・構造化データをSSRで埋め込み、見た目だけをCSRで上書きするアプローチが現実的です。

既存サイトでの移行は、重要テンプレの優先SSR化→プレレンダ導入→残差のJS最適化の順で、測定指標(レンダリング後DOMの安定性、インデックス率、クロール頻度)と結び付けて進めると安全です。

2. クロール予算最適化

成果を早く出すには、まずクローラーを重要ページに集中させることです。生ログでの可視化→robots.txt等のブロック→内部リンク/サイトマップで誘導という順序で、無駄なクロールを削り、重要URLの巡回頻度を底上げします。

ログ分析で不要クロールを特定する方法

第一歩は生ログの収集とテンプレ単位の集計です。ユーザーエージェント別にクローラーヒットを抽出し、テンプレごとのクロールKPI(総ページ数、重要URL比率、ステータス別分布)を可視化します。典型的な無駄クロールは、絞り込みパラメータだけのURL、noindexページのURL、canonical先が非自己参照のURL、ソートやトラッキング付きURL、404や500を多発させている壊れたテンプレです。

公開初期は週次で、落ち着いたら月次で、テンプレ別ヒートマップとステータス配分の推移を見ると異常に気づきやすいです。分析で「どこが浪費しているか」を特定したら、robots.txtやサイトマップ、内部リンクの優先制御に落とし込み、次のクロールからクロールバジェットを再配分します。

robots.txtでのブロック設計

ブロックの基準は「検索ニーズがなく、評価に寄与しないURL」を明確にすることです。ソート・トラッキング・セッションIDなどは優先ブロック候補ですが、最重要なのは「誤って重要URLを遮断しない」こと。robots.txtチェックツールでテストをした上で公開します。

既にインデックスされている不要URLは、まずnoindexで除外が反映されたことをGSCで確認してからrobots.txtでdisallowをする段階的運用が鉄則です。こうすることで、ブロックによりインデックスが残留してしまう事態を避けられます。反映後は生ログでクロールの減少を定量確認し、狙い通り重要テンプレのクロールが増えているかを突合します。

3. インデックス戦略の明確化

全ページを無差別にインデックスさせると、評価が薄まり効果が鈍くなります。検索ニーズとビジネスインパクトを軸に優先順位を付け、初期は広めに許容しつつデータで範囲を絞る「段階的・データドリブン運用」を徹底しましょう。

必要ページ判定と優先順位付け基準

index対象は「明確な検索ニーズ」と「高いビジネスインパクト」を満たすものを優先します。主要カテゴリ、詳細ページは原則対象とし、絞り込みの掛け合わせは想定クエリで実需が確認できたパターンに限定します。

KPIはSEO流入量を主指標に据え、対象拡張・縮小の前後で流入・CTR・CVRの変化を突合。季節性や在庫状況、キャンペーン等の要因も補正して意思決定します。

実運用では、対象外に落とすURLはnoindexやcanonicalで評価を整理し、サイトマップも主要URLに限定送信して「重要な面」を明快に伝えます。テンプレでは、需要の薄い組み合わせに固有価値(UGCや一次情報)を積み増すことで、将来的なインデックス候補へ昇格させる余地を作るのも有効です。

インデックス率改善の段階的アプローチ

手順は「不要クロールの削減→内部リンク強化→テンプレ改善」の順が効率的です。即効性があるのはrobots.txt調整と内部リンクの再配置、主要サイトマップへの限定送信で、これにより重要URLの発見が早まります。次いでテンプレの内容充実(title/description最適化、構造化データ付与、UGCなどコンテンツ設計)を行い、クロールからインデックス、表示の各段で摩擦を減らします。

時間がかかるのはシステム改修が絡むSEO施策ですが、持続的なインデックス率改善と評価安定の土台になるため、中長期案件として並行推進が必要です。効果検証はサイトマップ単位・テンプレ単位で設計し、改善が出たルールは運用へ自動適用することでスケールさせます。

4. URL設計とパラメータ管理

ファセット・パラメータはクロールとインデックスのコントロール装置です。全掛け合わせの解放は避け、検索ニーズのある組み合わせに限定。ホワイトリスト運用と自動正規化を前提に、設計段階からルール化しましょう。

ファセット設計とパラメータ運用ルール

設計は「ユーザーの検索行動」を起点に、エリア、カテゴリ、条件(価格帯・特徴・在庫など)の粒度を定義します。最初から全組み合わせを開くのではなく、想定クエリで実需が強いパターンをホワイトリスト化し、その他はnoindexやcanonicalを自動付与するルーティンを整えます。

運用では、サイトマップ送信もホワイトリスト優先とし、内部リンクは重要ハブから需要の高い組み合わせへ誘導。定期的なデータレビューで許可・除外の境界を更新し、季節性やキャンペーンで一時需要が立つ場合は暫定許可→事後評価で見直す可逆な運用を徹底します。

パラメータ正規化と管理フロー

原則として、検索ニーズのないパラメータはcanonicalで正規化し、評価の分散とクロール浪費を抑えます。GSCと生ログ、さらに一括チェックツール(https://valentin.app/inspect.html)で新規URLの発生とインデックス挙動を突合し、ルール逸脱を検知したら即座に正規化・除外に反映。

フローは「初期は広めにインデックス許容→流入データで不要特定→canonical/noindex→robots.txtでdisallowの段階的適用」。除外ルールは月次で見直し、需要が立ったものは一時的に許可へ昇格、効果がなければ再除外とします。

許可リストと除外規則の実例

インデックス許可の中心はメインカテゴリ、商品・店舗・求人などの詳細、データで需要が検証されたファセット組み合わせです。インデックス除外は、並び替え(sort)、セッションID、UTM等のトラッキング、そしてユーザー個別フィルタなど検索ニーズがない掛け合わせが対象。

初期は広めに許可しつつ、流入がつかない組み合わせはcanonical/noindexで整理、最終的にはrobots.txtでクロールも止める段階的アプローチが有効です。許可・除外の変更はサイトマップと内部リンクにも反映し、「重要な面」を検索エンジンに継続的に伝え続けることが、評価の安定化に直結します。

5. 重複・薄いページの統合基準

DB型は似通ったページを量産しがちです。統合・削除・noindexの判断をロジック化し、誤削除を避けつつ評価を集約。UX上必要なページはnoindexで残し、SEO上位を狙うページはcanonicalなどで一本化して評価を高めます。

統合/削除/noindexの判断フレーム

判断は「統合できるか」から始め、代表URLへ集約できるなら積極的に統合します。統合先がなく、検索需要も見込めない場合は削除を検討。UXや回遊のために必要だが検索価値の低いものはnoindexで残すのが原則です。

迷うケースの多くは検索ニーズの調査不足に起因するため、クエリデータ、季節性、在庫・掲載数、競合の露出状況を踏まえた将来価値の見積りを標準化します。運用では、判断履歴と効果(流入・インデックス・CV)をテンプレ単位で記録し、同種ケースに再利用できるように知見化します。

動的差し替えでのコンテンツ強化手順

自動生成ページをAIテキストだけで埋めるのは差別化を損ない逆効果です。UGC(レビュー、Q&A、写真)、自社が収集した一次データ(在庫、独自指標、検証結果)をテンプレへ動的差し込みして独自性を高めます。

手順は、ユーザー投稿導線の設計→収集・審査のルール化→掲載基準の自動評価→コンテンツ反映の仕組み化…という流れが実務的です。UGCは量が集まるまで時間がかかりますが、最初から見出しやスニペットに反映できるUI/UXを敷くと価値の顕在化が早まります。

一次情報は更新頻度と鮮度も評価対象になるため、lastmodや構造化データに時点情報を載せて検索エンジンに明示します。結果として、ページ単位の独自性が増し、重複判定の回避とCTR向上の両立が期待できます。

6. noindex/canonical運用ルール

noindexは「出すべきでないものを確実に隠す」指示、canonicalは「類似の評価を一本化してほしい」提案です。目的が異なるため、設定と検証のループを仕組みにし、想定と結果のズレを早期に補正します。

noindexとcanonicalの使い分けガイド

完全に検索結果から排除したいページ(内部検索結果、重複の明白な派生URL、トラッキング付)はnoindexを優先。内容が近い複数URLの評価を一本化したい場合はcanonicalで正規URLを宣言します。

ただしcanonicalは強制力が弱く、検索エンジンの裁量が入る点に注意が必要です。適用後はGSCでインデックス状況と「正規化されたURL」の判断を追い、意図と乖離する場合は信号を増やす(内部リンクやサイトマップでも正規URLを強調)か、noindexへ切り替えます。

運用ルールのドキュメント化と適用例

運用ルールは仕様書に落とし込み、適用〜検証〜是正の手順を共通化します。実例として、不要URLはまずnoindexでの除外をGSCで確認し、反映を確認後にrobots.txtでクロール停止へ移行する段階的運用が安全です。

canonicalは適用前後でバルクのインデックス数と主要KW順位、流入の差分を比較し、狙い通り集約できているかを評価します。設定の根拠、適用範囲、結果は履歴を残し、次回以降の同種ケースの意思決定を迅速化します。

7. サイトマップと構造化データ自動化

サイトマップと構造化データはスケーラブル運用の要です。テンプレや階層ごとに分割生成し、GSCでの監視粒度を上げつつ、lastmodを自動更新して鮮度を伝えます。構造化はテンプレ化とバリデーションで事故を防ぎます。

サイトマップ自動生成の設計原則

サイトマップはテンプレート別・URL階層別に分割し、GSCでサイトマップ単位のインデックス状況を把握できるようにします。(GSCでサイトマップ送信⇒「ページ」でサイトマップごとのインデックス状況を可視化できます)

大規模サイトでは全末端URLを送る必要はなく、重要URLだけをサイトマップに含めます。クローラーのページクロールの判断は、サイトマップに含まれていることより内部リンクの方が優先度が高いです。基本は内部リンク設計を完璧にし、サイトマップは補助的に利用する認識でいきましょう。

lastmodは実データの更新にあわせて自動更新することが理想です。リストページは情報の追加削除、掲載しているページの更新があったタイミングで日付を更新。詳細ページはページ内のコンテンツが更新されたタイミングでlastmodを更新します。

構造化データのテンプレ実装例

構造化データはテンプレ化して手動設定を排除します。求人はJobPosting、ECはProduct、リストはItemListなど、代表スキーマを標準搭載し、公開前後はリッチリザルトテストとGSCのレポートで差分を記録。必須・推奨プロパティの入力検証、データ欠落時のフォールバック、マークアップのバージョニング管理も仕組みに含めます。

8. 内部リンクと評価循環の設計

内部リンクは評価分配とインデックス促進の心臓部です。検索ボリュームとビジネスインパクトを基準に重要ページを定義し、TOP→カテゴリ→一覧→詳細の流れに、関連横断リンクを重ねて評価を循環させます。

重要ページへ評価を送る導線設計

重要ページは「検索需要×事業インパクト」で選定し、トップからカテゴリ、一覧、詳細へ自然な深度の導線を設計します。カテゴリ・一覧では、需要の高いサブカテゴリや特集への導線を強調し、詳細ページでは関連条件・エリア・類似アイテムへの横リンクで滞在と評価の循環を促します。

アンカーテキストはユーザー意図に沿う自然言語を用い、テンプレに「優先リンク枠」を設けて季節や在庫にあわせて差し替え可能にすると運用効率が高まります。内部リンクは量より意味で、クリック・スクロールの妨げにならない配置がCTRとCVの向上にも寄与します。

パンくず・ハブページとカテゴリ設計

パンくずは全テンプレートで統一します。ハブページはビッグキーワードを中心に設計し、カテゴリ設計はカテゴリ種類ごとにユーザーの検索ニーズを調査したうえで、それに沿った構造にします。ベンチマークサイトがある場合は、その流入KWデータやカテゴリ設計を参考にすることで、初期の設計工数を削減できます。

NGな構造として、関連性に関わらずすべてのページに一律でリンクを張り、内部リンク数が大量になってしまう設計は避けてください。内部リンクは関連性の高いページに絞って設計することが重要です。

9. メタ(title/description)テンプレ最適化

大規模サイトの大量ページでもCTRは設計で伸ばせます。主要語の自然な接続、長さ・語順・日本語の滑らかさをルール化し、期間分割によるABテストの効果検証をワークフロー化しましょう。

テンプレ設計と動的最適化ルール

タイトルテンプレは、主要キーワードを自然な語順でつなげた基本形を定義します。機械的な印象にならないよう、ユーザー目線でCTRも意識した設計を心がけてください。

動的生成では、条件の掛け合わせによってタイトルが長くなりすぎたり、不自然な日本語になったりしないよう注意が必要です。NGパターンとして、単語を羅列するだけの無機質なタイトルは避けてください。

A/BテストでCTRを改善する手法

SERPのABテストは厳密な同時比較が難しいため、期間を分けた比較実験が現実解です。ベースライン期間でCTR・順位・流入を取得し、変更後の同期間・同条件で差分を評価します。影響の大きい外的要因(季節性、広告出稿、在庫変動)をメモし、因果の解釈を誤らないようにします。

効果が確認できたテンプレは自動適用し、スコアが悪いセグメントは別案で再検証。デバイス別・地域別・テンプレ別の粒度で見ると、勝ちパターンの再現性が高まります。

10. 監視体制と生ログ運用の整備

GSC・GA4・生ログを中核に、クロール→インデックス→ランキング→CVを一気通貫で監視する体制を作ります。異常検知と原因特定が速い組織は、順位や流入の変動にも強くなります。

GSC/生ログで監視すべきKPI一覧

重視すべきは、サイト全体のクロールボリューム、重要ページごとのクロール頻度、総ページ数に対するクロール割合、インデックス率、主要KWの順位推移、そしてCVに至る流入です。

サーバ応答が悪化するとクロールが落ち、不要URLへのクロールが増えると重要URLのクロールが減る、といった相関を生ログとGSCの突合で早期に掴みます。

インデックスの急増・急減、URL正規化の不具合、構造化データのエラー増加は、テンプレ事故や運用ミスのシグナルです。リリース初期は週次、安定後は月次の定点観測に加え、しきい値を超えたらアラートが飛ぶ自動監視を整備すると、現場の負荷を抑えながら品質を維持できます。

ダッシュボードと月次運用ワークフロー

ダッシュボードは「クロール・インデックス・ランキング・CV」の4観点でKPIを設計し、数値に対する課題と対策を紐づけます。

月次では、各KPIの課題整理→優先順位付け→実行スケジュール化→進捗確認→効果測定をルーチン化。優先度は改善インパクトと実装コストの見積りで決め、短期の問題解決(robots.txt/noindex/内部リンク)と中長期の改修(SSR/テンプレ刷新/自動化)を併走させます。

ケーススタディ:導入前→施策→結果

実務では「課題把握→技術的対策→内部施策→監視と改善」の流れが定石です。最初にクロール最適化へ集中し、次にインデックス対象の明確化と内部リンク再設計、最後にテンプレ強化で質を底上げする順序が成功確度を高めます。

大規模DBサイトの改善フロー事例

業界トップクラスの知名度を持ちながらも長年SEOが伸び悩んでいた美容ECサイト(1万ページ以上)の事例です。

初期課題は、主力の商品一覧ページの順位低迷(3〜10位・2ページ目以降)と、テクニカルSEOの社内ナレッジ不足による改善箇所の特定困難でした。

実施した施策は、サーチコンソールを用いた重複コンテンツ・低品質ページ・noindex/canonical制御の調査、パンくずや内部リンク設計の見直し、構造化マークアップの正確性確認、XMLサイトマップの整備など、テクニカルSEOの徹底的な内部改善です。加えて被リンク営業による外部施策も並行して実施しました。

結果として、施策スタートから3ヶ月目に順位上昇が見られ、4ヶ月目にはUU1.35倍・昨対比売上124%(数千万円UP)を達成。主力商品の多くのキーワードが1〜3位に上昇しました。

参考:https://ny-marketing.co.jp/case/ec-beauty/

よくある失敗と現場での回避策

一番多い失敗は、クロール最適化の必要性を現場が理解できていないことです。表面上は見えないテクニカルSEOのマイナス要素が多く潜んでいても気づかれず、対処が後手に回ってしまいます。

防ぐためには、テクニカルSEOは専門性が高い領域であるため、NYマーケティングのような外部の専門家を早い段階で入れることが有効です。

実務では、まずクロール・インデックス・ランキング・CVの4つの軸で課題を切り分け、問題を明確化します。そのうえで施策と改善インパクトを整理し、ダッシュボードでKPIを管理しながらスピーディーに実行していきます。

推奨ツール一覧と使い分けガイド

ここではDB型サイトのスペシャリスト、NYマーケティングの中川が実際に使用しているツールを紹介します。

GSC/GA4/生ログ解析/クロールツール等の用途別一覧

日常運用の中核は、GSC・GA4・自社生ログ分析ツール・リッチリザルトテスト・クロール/インデックス一括チェックツールの併用です。KPI別に使い分けることが重要です。

それぞれの役割と使い分けは以下のとおりです。

クロール分析はGSCとクロール/インデックス一括チェックツール(https://valentin.app/inspect.html)、および生ログ分析ツールを組み合わせて確認します。インデックス状況はGSCとリッチリザルトテストで把握し、ランキングはGSC・GA4・順位計測ツールを併用、CVはGA4と応募DBを統合して評価するのが基本線です。

構造化データの検証はリッチリザルトテストとGSCを併用し、公開前後の差分を記録しておくと因果が追いやすくなります。Indexing APIは更新頻度が高く即時反映の価値が大きい重要ページに限定して活用し、通常はサイトマップの自動更新と内部リンク最適化で十分です。

平時はGSCの「ページ」「求人インデックス」レポートでサイトマップ別の状況を監視し、新規・修正URLは一括チェックツールで即時確認、生ログで実際のクロール到達と応答を突合することで、異常の早期検知と原因特定がスムーズになります。

まとめと当社サービスのご案内

DB型SEOで成果を出す最重要ポイントは、「ボトルネックの正確な把握」と「正しい施策の策定・確実な実行」です。

当社の強みは、代表の中川(SEO経験16年)が直接支援し、技術とSEOの両面から調査〜改善指示書作成まで一気通貫で伴走できる点です。ポータルの大規模グロース経験を含む多様な事例知見を、設計・運用・監視に落とし込んで成果へ接続します。

支援プランは、調査から実装指示まで丸投げできるフルサポートプランと、月10万円の顧問プランの2パターンをご用意。対象はデータベース型サイトで、インデックス・流入・CVをさらに伸ばしたい企業様です。

最短で成果を出すなら「クロール最適化→インデックス戦略の明確化→内部リンク設計」の順に着手し、ルールはテンプレと自動化に織り込む。測定と検証を月次で回し、勝ちパターンを標準化しましょう。

| 施策領域 | 初動優先度 | 即効性 | 中長期効果 |

|---|---|---|---|

| クロール予算最適化(ログ→robots) | 最優先 | 重要URLの発見促進 | インデックス率と順位の安定化 |

| インデックス戦略(許可/除外の明確化) | 高 | 評価の集中 | 流入とCVの効率最大化 |

| 内部リンクとハブ設計 | 高 | 回遊・CTR改善 | 評価循環の定着と伸長 |

| テンプレ最適化・構造化データ | 中 | 表示機会とCTRの増加 | ドメイン評価の強化 |